Il settore sanitario sta sperimentando da tempo i benefici derivanti dall’uso dell’Intelligenza Artificiale ma, allo stesso tempo, non è esente da pericoli informatici ad essa legati.

Netskope Threat Labs ha pubblicato il suo ultimo report sulle minacce che prende in esame il settore sanitario negli ultimi 12 mesi (1° marzo 2024 – 31 marzo 2025). Dal report emerge che i lavoratori di questo settore tentano regolarmente di caricare dati sensibili su siti web non approvati o piattaforme cloud non autorizzate. Le applicazioni di intelligenza artificiale generativa (GenAI), come ChatGPT o Google Gemini — le due più comunemente utilizzate dagli operatori sanitari — sono spesso coinvolte in tali violazioni delle policy sui dati, poiché il loro utilizzo negli ambienti di lavoro sta diventando sempre più diffuso.

Violazioni legate all’uso della GenAI in ambito sanitario

Dal report emergono i seguenti risultati principali:

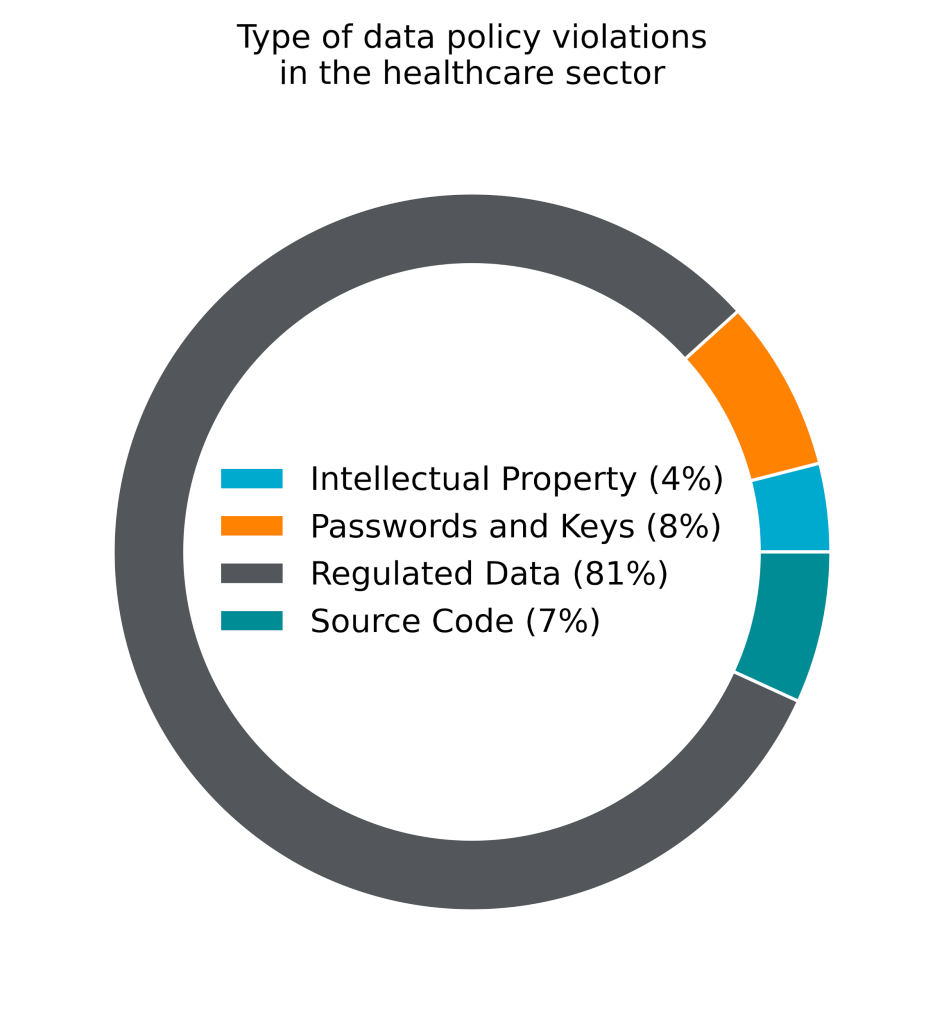

- L’81% di tutte le violazioni delle policy sui dati che si sono verificate nelle organizzazioni sanitarie negli ultimi dodici mesi ha riguardato dati sanitari regolamentati, ovvero dati protetti da normative locali, nazionali o internazionali, che includono informazioni mediche e cliniche sensibili. Anche password e chiavi di accesso, codice sorgente o proprietà intellettuale sono stati coinvolti (per un totale del 19%), e un gran numero di tali violazioni è stato causato da individui che hanno caricato dati sensibili su account personali di Microsoft OneDrive o Google Drive.

- L’intelligenza artificiale generativa è ormai onnipresente e le applicazioni basate su GenAI sono attualmente utilizzate nell’88% delle organizzazioni sanitarie. Una larga parte delle violazioni delle politiche sui dati avviene ora nel contesto dell’utilizzo della GenAI da parte degli operatori sanitari, con il 44% dei casi che coinvolge dati regolamentati, il 29% codice sorgente, il 25% proprietà intellettuale e il 2% password e chiavi di accesso. Ulteriori rischi di perdita di dati possono derivare da applicazioni che utilizzano i dati degli utenti per l’addestramento, o che integrano funzionalità basate su GenAI, utilizzate rispettivamente nel 96% e nel 98% delle organizzazioni sanitarie.

- Oltre due utenti su tre di GenAI nel settore sanitario utilizzano e inviano dati sensibili ai propri account personali di GenAI durante l’orario di lavoro. Questo comportamento ostacola la visibilità da parte dei team di sicurezza sulle attività legate alla GenAI tra il personale e, in assenza di adeguate misure di protezione dei dati, compromette la loro capacità di rilevare e prevenire fughe di dati.

Best practice per prevenire le minacce cyber

Le organizzazioni sanitarie possono considerare di:

- Implementare applicazioni di intelligenza artificiale generativa approvate dall’organizzazione tra il personale, al fine di centralizzare l’uso della GenAI in strumenti approvati, monitorati e protetti dall’organizzazione stessa, riducendo così l’utilizzo di account personali e della cosiddetta “shadow AI”. L’uso di account personali di GenAI da parte degli operatori sanitari, sebbene ancora elevato, è già diminuito dall’87% al 71% nell’ultimo anno, poiché le organizzazioni stanno progressivamente adottando soluzioni di GenAI approvate a livello aziendale.

- Implementare rigorose politiche di prevenzione della perdita dei dati (Data Loss Prevention – DLP) per monitorare e controllare l’accesso alle applicazioni di GenAI, e definire il tipo di dati che possono essere condivisi con esse, offre un ulteriore livello di sicurezza nel caso in cui i lavoratori compiano azioni rischiose. La percentuale di organizzazioni sanitarie che hanno adottato politiche DLP per la GenAI è aumentata dal 31% al 54% nell’ultimo anno.

- Implementare strumenti di formazione in tempo reale per gli utenti, che avvisano i dipendenti quando stanno compiendo azioni rischiose. Ad esempio, se un operatore sanitario tenta di caricare un file su ChatGPT contenente nomi di pazienti, un messaggio che appare sul suo schermo chiederà all’utente se desidera procedere. Un altro report di Netskope mostra che la grande maggioranza dei dipendenti (73%) in tutti i settori si ferma dopo aver ricevuto simili avvisi.

Netskope fornisce protezione dalle minacce a milioni di utenti in tutto il mondo. Le informazioni presentate in questo report si basano su dati di utilizzo resi anonimi raccolti dalla piattaforma Netskope One, su un sottoinsieme di clienti Netskope del settore sanitario che hanno dato autorizzazione preventiva affinché i loro dati vengano analizzati.

Dichiarazioni

Gianpietro Cutolo, Cloud Threat Researcher presso Netskope Threat Labs, ha commentato così i risultati del report: “Le applicazioni di intelligenza artificiale generativa offrono soluzioni innovative, ma introducono anche nuovi vettori per potenziali violazioni dei dati, soprattutto in ambienti ad alta pressione e criticità come quello sanitario, dove il personale e i professionisti devono spesso operare con rapidità e agilità. Le organizzazioni sanitarie devono bilanciare i benefici della GenAI con l’adozione di misure di sicurezza e protezione dei dati per mitigare tali rischi”.

“Nel settore sanitario, la rapida adozione delle applicazioni di intelligenza artificiale generativa e l’uso crescente delle piattaforme cloud hanno reso ancora più urgente la protezione dei dati sanitari regolamentati”, conclude Gianpietro Cutolo. “Man mano che la GenAI viene integrata nei flussi di lavoro clinici e operativi, le organizzazioni stanno accelerando l’implementazione di controlli come le politiche DLP e il blocco delle applicazioni per ridurre i rischi. Le organizzazioni sanitarie stanno facendo progressi, ma sarà fondamentale mantenere l’attenzione su soluzioni sicure e approvate a livello aziendale, per garantire che i dati restino protetti in questo scenario in continua evoluzione”.